DeepSeek 又半夜”上大分”。

DeepSeek 又半夜”上大分”。

阿里这边刚把新旗舰模型官宣完,那边 DeepSeek 就憋不住了,直接扔出:DeepSeek-OCR 2。

这次看着像是“迭代版”,其实更像是:

把他们去年刚刚跑通的那条“视觉压缩路线”,整个推到了下一层。

一句话版本:

DeepSeek-OCR 2 用一个基于 Qwen 的新架构,把「看图这件事」改成了:

不是先老老实实扫一遍图,再交给大模型,而是边看边判断哪里重要,边编码边“理解”。

01 去年那波:他们先把“视觉压缩”打成一个概念

如果你有印象的话,DeepSeek-OCR 1 上线的时候,很多人第一次意识到:

OCR 也许不是“怎么把每个像素都识别正确”,

而是“怎么给大模型喂一个最有利于理解的压缩表示”。

传统 OCR(包括现在很多多模态大模型里那套视觉模块)基本都是一个套路:

-

均匀、规则地切图、扫图

-

每块都编码成视觉 token

-

然后一股脑儿扔给后面的语言模型

问题也很明显:

谁重要、谁不重要,视觉侧一点都不管。

就像你拿着扫描仪在扫页面:标题、正文、页脚、广告,全都一视同仁,后面再指望语言模型自己去抠关键信息。

DeepSeek-OCR 1 做了一件不太一样的事:

它把 OCR 重新定义成 “视觉压缩问题”:

-

不是追求“尽量不丢信息”,

-

而是追求“压缩成对语言模型最友好的那种中间表示”。

这也是为什么一堆人后来用它做 PDF 阅读、网页结构抽取、图文混排解析,会感觉“这玩意儿有点不一样”。

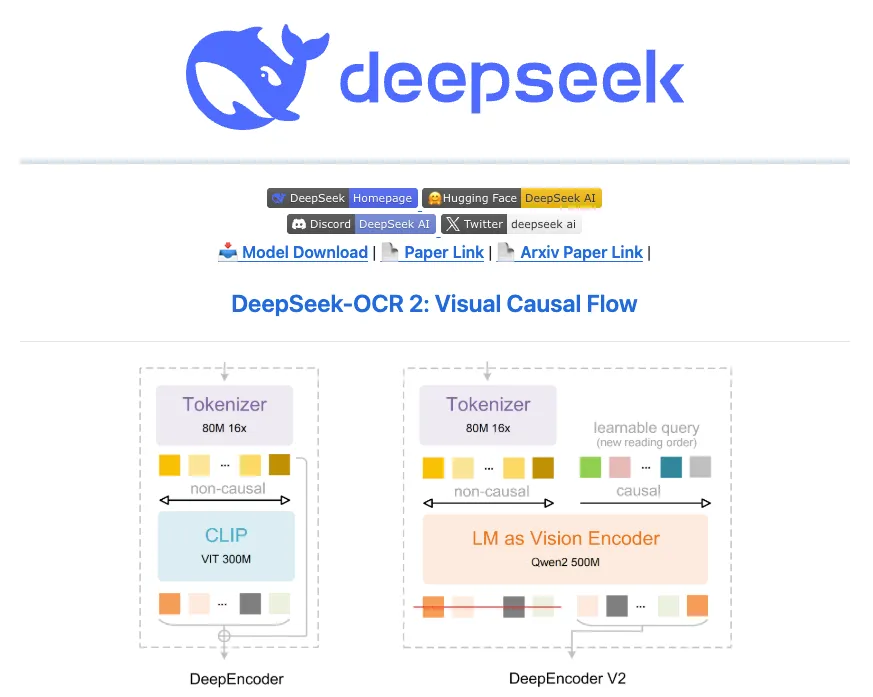

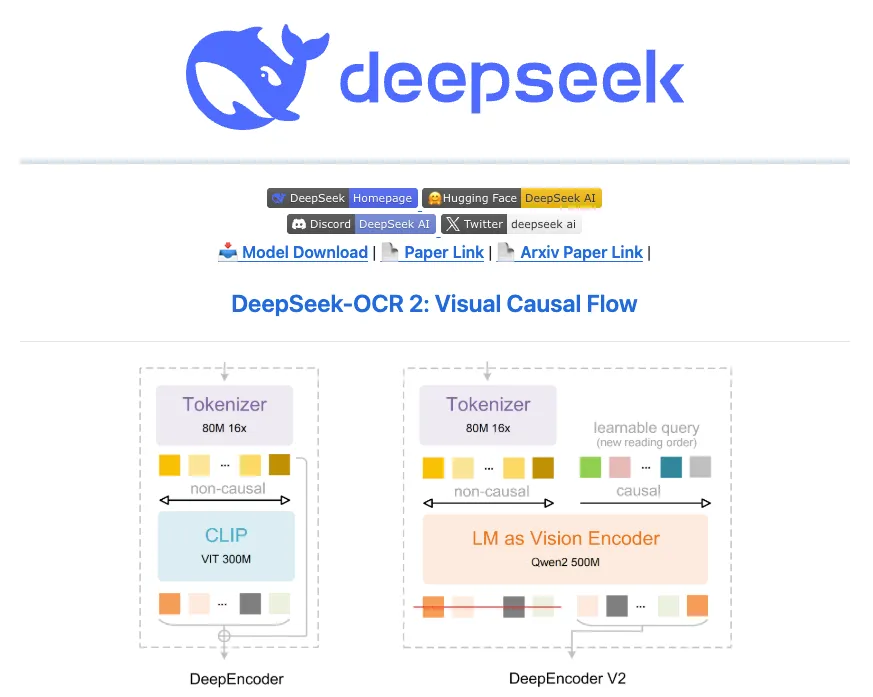

02 这次升级:DeepEncoder V2,让视觉编码提前进入“理解阶段”

DeepSeek-OCR 2 的核心,是一个叫 DeepEncoder V2 的东西。

文章里有一句话可以概括这个变化:

它不再把视觉编码当成一次“静态扫描”,

而是变成一个**“语义驱动的动态编码过程”**。

翻译成更直白一点:

-

模型在“看图”的阶段就开始思考:

“这块区域到底值不值得我花 token 去描述?” -

视觉 token 的分配不再是均匀的,而是:

-

重要的区域:多给点 token、描述得更细

-

不重要的区域:压缩、略写、甚至忽略

-

这种设计有两层含义:

-

视觉编码不再只是“预处理”

而是直接把“理解任务的一半”提前挪到了视觉侧。

—— 类似你看一篇论文,不会逐字念,而是先扫标题、小节、公式、图,脑子里先搭起结构。 -

和“注意力资源有限的 LLM”更配

大模型的上下文窗口再大,也不是无限的。

如果视觉侧能做到“事先筛选 + 带结构的压缩”,

实际上整个多模态系统会更像一个有策略的人类读者,而不是一个笨拙的扫描仪。

在实现上,官方在技术报告里提到:

这一套 DeepEncoder V2 是用 Qwen2-0.5B 实例化的。

这在工程上有一个很现实的信号:

他们没有一上来就堆一个超大视觉 backbone,而是刻意选了一个相对小的通用基座(0.5B),说明他们更看重的是:

“视觉 token 编排逻辑”本身的创新,

而不是简单堆参数换性能。

03 跟我们熟悉的“多模态 OCR”有什么本质差别?

对比一下现在常见的几种路线:

-

传统 OCR 流水线:

检测 → 识别 → 后处理-

优点:稳定、工程成熟

-

缺点:对复杂布局、多语言、多栏混排、公式表格、跨页引用等等,经常会乱成一锅粥

-

-

多模态大模型自带的视觉编码(均匀切 patch):

-

优点:通用、能一把梭哈所有视觉任务

-

缺点:token 超多,而且“重要”和“不重要”一视同仁

-

-

DeepSeek-OCR 系列:

-

1 代:把 OCR 当“视觉压缩”,为 LLM 专门定制视觉中间表示

-

2 代:在压缩的基础上,再加 “语义驱动的动态重排”

-

如果你平时有做这几类事情,会比较有感觉:

-

法律合同、招股书、技术白皮书这类 长 PDF OCR + 结构抽取

-

产品文档、API 文档、知识库这类 图文混排解析

-

含有表格、流程图、截图说明的 “人类文档”

这种场景下,视觉编码“是否懂语义”,直接决定了:

-

你后面问大模型问题,它答不答得上来

-

相同上下文长度下,它能不能把关键内容塞进去

DeepSeek-OCR 2 的思路,是正面回答这个问题:

“视觉编码本身也要开始做选择,而不是纯搬运。”

04 更重要的是:这套东西直接开源了

按照 DeepSeek 一贯风格,这次依然是:

-

模型、代码、技术报告 同时开源

-

仓库、论文、模型权重都已经挂上去:

项目地址:https://github.com/deepseek-ai/DeepSeek-OCR-2

论文地址:https://github.com/deepseek-ai/DeepSeek-OCR-2/blob/main/DeepSeek_OCR2_paper.pdf

模型地址:https://huggingface.co/deepseek-ai/DeepSeek-OCR-2

这对开发者和创业者,有几个很现实的影响:

-

国产“文档理解 / 知识库构建”这条线,门槛又被拉低了一截

之前很多人是直接拿通用多模态模型硬上,现在可以考虑:-

视觉侧用 DeepSeek-OCR 2 做“语义友好的压缩中间层”

-

后面接自家适配过的 LLM 或检索系统

-

-

做垂直行业工具的人,终于有了一个“可以改、可以私有化”的视觉基础设施

尤其是:-

法律、财务、医疗、科研等高密度文本领域

-

对“隐私 + 本地部署”有刚需的企业内部系统

-

-

国内在“视觉编码范式”上的话语权,开始实打实多了一种方案

这不是简单“我们也有一个多模态模型”,

而是提出了一套和主流 patch 路线不同的思路,并且用落地产品(DeepSeek-OCR)让大家先尝到了甜头。

05 这条路会走到哪?一些个人判断

从这两代 OCR 的演进,可以看出几个趋势:

-

“视觉压缩”会成为一个独立赛道,而不只是多模态里的一个细节

未来很可能有越来越多模型,不再追求“什么图都丢给 LLM”,

而是先做好“按任务定制的视觉压缩层”。 -

语义驱动的视觉编码,会成为长文档、多图场景里的标配能力

现在我们已经习惯用 RAG 来解决长文本问题,

下一步很自然的问题是:

“RAG 之前,这一堆图和 PDF,到底应该怎么被编码和筛选?” -

对开发者来说:OCR 不再只是“识别文字”,而是“把文档变成可用的结构化知识”

-

把图像 → token

-

token → 结构化节点(章节、条款、表格、引用)

-

再配合 LLM 和检索

DeepSeek-OCR 2 更像是在帮你打好了第一层地基。

-

06 对你能做什么?一些应用方向建议

如果你本身就在做 AI 工具 / SaaS / 内部系统,这波可以重点想想:

-

现有产品里所有“上传 PDF/图片”的入口

-

能否把底层的 OCR 模块换成更智能的视觉压缩编码

-

尤其是那些“用户问问题,总是答不到点上”的地方

-

-

知识库构建 / 私有文档理解

-

不要再只做“纯文本分段 + 向量化”

-

可以试着走一条链路:

图像 → DeepSeek-OCR 2 → 结构化片段 → RAG/Agent

-

-

偏垂直行业的“智能文档助手”

-

法务:合同条款抽取、风险标注

-

财务:报表表格识别、数据对齐

-

运营:活动物料、海报、H5 页面信息抽取

这些场景的共同点是:

“视觉结构比单纯文字本身更重要”,DeepSeek-OCR 2 这种语义驱动的视觉编码会有天然优势。

-

最后

如果说去年的 DeepSeek-OCR 是在告诉行业:

“视觉压缩这条路,其实很值得走。”

那今年的 DeepSeek-OCR 2,更像是在加一句:

“而且这条路,不只是降成本,而是能直接升级多模态的‘理解方式’。”

对于做产品、做工程的人来说,这不是一篇“刷完就完”的新闻,

而是一个可以立刻去 GitHub 下模型、跑 demo、改 pipeline 的信号。

真正的红利,永远在“你把它接进自己系统之后”才开始。